L'essor de l'apprentissage profond dans le diagnostic du cancer

Article du Docteur Christophe DESTERKE, chercheur Hôpitaux Universitaires Paris Sud-Bicêtre - Paul Brousse Inserm U935

Le développement de l’intelligence artificielle a été initié au cours des années 50, par les mathématiciens John Mc Carthy et Marvin Minsky avec leurs travaux visant à développer un ordinateur pouvant simuler les facultés cognitives des humains et des primates. En effet, les algorithmes d’intelligence artificielle ont été programmés avec une base pouvant se conformer à différents modèles biologiques et sociaux tels que : l’évolution des espèces, l’auto-organisation des insectes en sociétés, la plasticité synaptique avec l’évolution des connections entre les neurones dans le cerveau et la maturation des idées au travers des réseaux sociaux.

L’intelligence artificielle ne date pas d’hier et son développement a connu des périodes sombres notamment entre les années 60 à 90 jusqu’à l’avènement de l’apprentissage profond au cours des années 2000. L’apprentissage profond lié à l’intelligence artificielle est basé sur des algorithmes se référant à la propagation de l’information entre les différentes couches de neurones qui constituent notre cerveau.

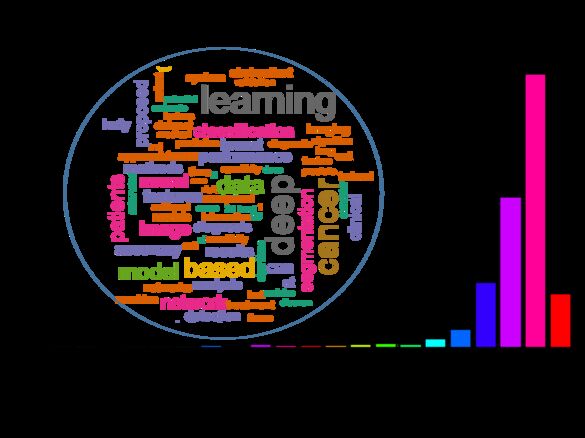

L’emploi des algorithmes d’apprentissage profond à l’étude du cancer a commencé à progresser à partir de l’année 2015 comme en témoigne l’histogramme du nombre de publications biomédicales dans ce domaine (figure 1). Notamment, ce nombre de publications double chaque année ce qui témoigne de l’engouement de ces outils pour l’étude du cancer.

Plus particulièrement, des algorithmes d’apprentissage profond liés à la reconnaissance des formes dans les images ont été développés pour simuler la reconnaissance visuelle par ordinateur. Ces algorithmes, dits en réseaux de neurones convolutifs miment, la vision par le fait qu’ils s’efforcent de reproduire la vision en reconstituant une image tout comme le fait les neurones de la rétine pour propager les informations d’une image dans le cerveau. Les premières couches de neurones extraient des caractéristiques de structure de l’image et ensuite les caractéristiques de ces structures sont propagées dans les couches intermédiaires de neurones tout en conservant leurs hiérarchies structurales. Enfin, les informations sont agglomérées dans la couche finale de neurones pour prédire une décision de reconnaissance de forme dans l’image.

L’étude de texte des résumés des articles de la figure 1 montre que les mots : CNN (« Convolution Neuronal Network » pour réseaux neuronaux convolutifs), image, diagnostic, segmentation , « features » sont assez prépondérants dans cette littérature spécialisée. Ce qui augure que l’apprentissage profond dans le domaine du cancer s’applique essentiellement sur la reconnaissance d'images par des réseaux CNN. On peut citer certains exemples d’application de ces CNNs mis en œuvre dans le diagnostic du cancer. La détection des tumeurs cutanées est possible par apprentissage profond effectué sur une base de données de photographies de la peau constituée avec des téléphones portables (Esteva et al. 2017). Dans cette étude l’algorithme d’apprentissage profond de type CNN a permis de distinguer les lésions malignes (carcinomes et mélanomes) des lésions bénignes avec une efficacité tout aussi importante que la décision aggrégée de 22 pathologistes.

L’apprentissage profond par CNN s’applique également à la reconnaissance d’images en radiologie médicale comme le montre une étude effectuée par apprentissage sur des clichés de mammographies pour la détection de tumeurs mammaires (Ribli et al. 2018).

L’essor de l’apprentissage profond dans le diagnostic du cancer prend une place croissante dans les moyens de détection visuelle de cette maladie mais il reste une part d’ombre dans la compréhension de l’efficacité de ces algorithmes à détecter des évènements qui parfois ne sont pas perceptibles par l’œil humain.

Références Esteva, Andre, Brett Kuprel, Roberto A. Novoa, Justin Ko, Susan M. Swetter, Helen M. Blau, et Sebastian Thrun. 2017. « Dermatologist-Level Classification of Skin Cancer with Deep Neural Networks ». Nature 542 (7639): 115‑18. https://doi.org/10.1038/nature21056. Ribli, Dezső, Anna Horváth, Zsuzsa Unger, Péter Pollner, et István Csabai. 2018. « Detecting and Classifying Lesions in Mammograms with Deep Learning ». Scientific Reports 8 (1): 4165. https://doi.org/10.1038/s41598-018-22437-z.